بنظام Anthropic الجديد: بوّابة بحث ذكية مع كلود

مجموعة “multi-agent” تضاعِف سرعة ودقة البحث، مش كود مجرد واحد، بل فريق من الـ Claude agents.

الكاتب يتحدث عن ازاي انثروبك قدرت تبني a multi-agent research system لتعزيز قدرات البحث المفتوح والمعقد بالـ Claude model، جنبًا إلى جنب مع دروس هندسية حقيقية في المشوار من الفكرة للإنتاج.

أهم النقاط والتحديثات:

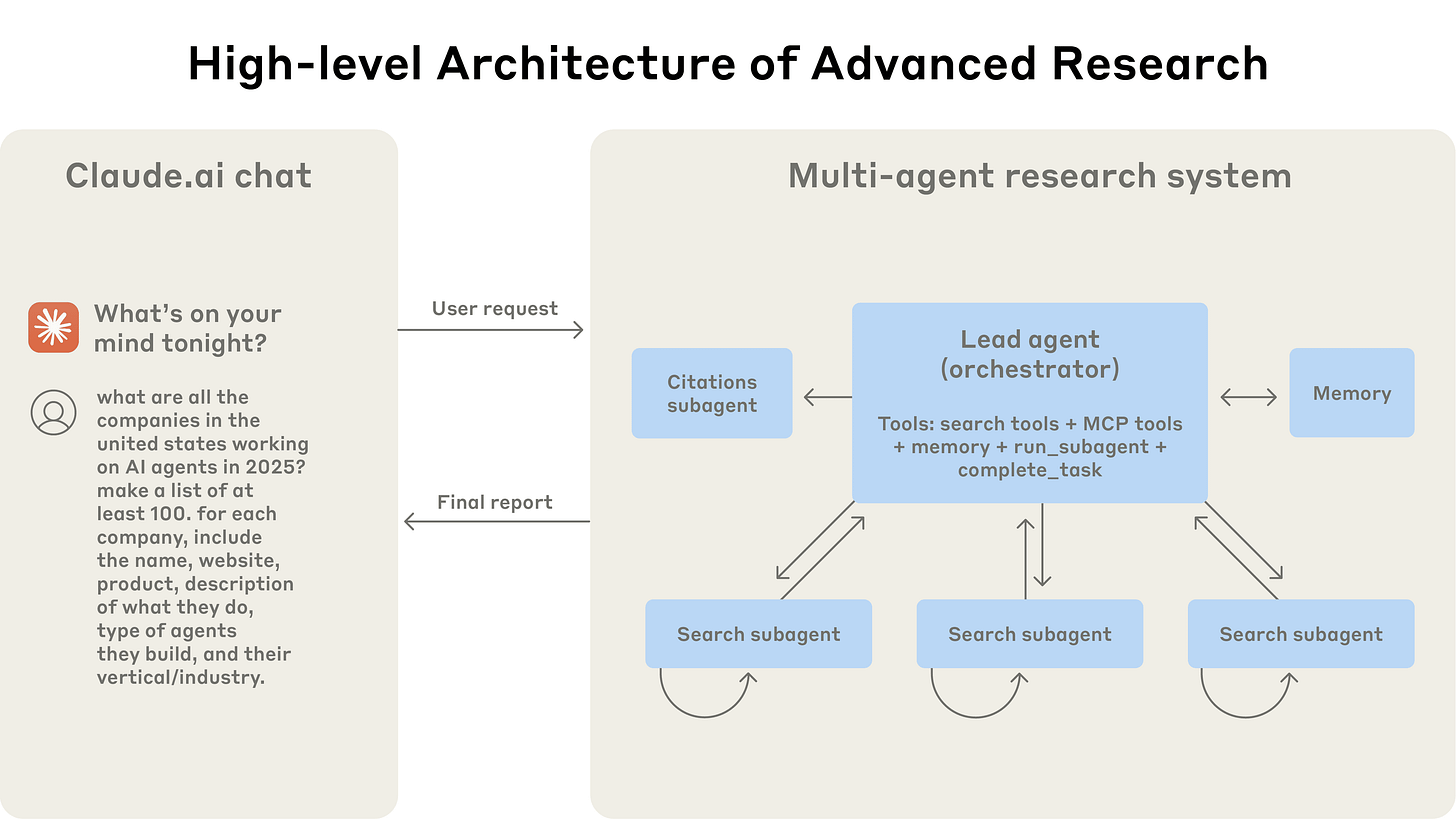

هيكلية النظام: قائد ووكيلين

النظام بيشتغل بنمط orchestrator-worker، يعني فيه lead agent (قائد البحث) عمل خطة مبتكرة بعدما يستلم السؤال من المستخدم، وبعدين يولّد subagents متخصصة تشتغل في موازي على جوانب مختلفة من الموضوع ([turn0search0], [turn0search1])، وتُرجع نتائجها للـ lead علشان يركّب الإجابة النهائية.

بحث ديناميكي مش تقليدي (RAG static)

مش زي النُظم اللي بتجيب نصوص جاهزة من قاعدة بيانات دايمًا، هنا النظام بيعمل multi-step dynamic search يتكيّف مع النتايج الجديدة على طول، وده بيخلي الردود أدق وأوسع.

سرعة وكفاءة عالية

المقارنة بين النظام متعدد الوكلاء ونظام Claude وحيد أظهرت تحسين أداء حوالي 90% في مهام البحث واسعة النطاق، بسبب المعالجة المتوازية والتقسيم الذكي للمهمة.

تكلفة حسابية أعلى

هذا الأداء المذهل جاي بـ ثمن: النظام بيستخدم بين 4× إلى 15× عدد الـ tokens أكتر من المحادثة العادية، فالأفضل استخدامه في المهام عالية القيمة فقط.

هندسة الع prompts بتعمل الفرق

المشرفين كانوا بيكتبوا prompts بعناية — يعلموا القائد إزاي يوزّع المهام، ويشرحوا لكل subagent مهمته وأدواته وسياسته. حتى ميزوا عدد الـ subagents حسب تعقيد السؤال: المهام البسيطة واحدة أو كذا، والمركّبة أكثر من عشرة.

القائد بيتحسّن بـ Claude نفسه

Anthropic استخدموا Claude (نسخة Claude 4 أو Sonnet 4) مش بس كوكيل، لكن كـ prompt-engineer أيضاً — علشان يحل مشكلات في وصف الأدوات، ويقلّل زمن تنفيذ المهام، وحسّن الوكلاء.

أهمية الأدوات Tool Design

كل subagent بيستخدم أدوات واضحة ومُفصّلة، زي البحث الإلكتروني أو محركات التحقق، علشان يضمن الدقة ويقلل الأخطاء. كمان وجدوا إن وصف الأدوات لو مش واضح، بيضيع الوكلاء في طرق تانية.

التقييم والمتابعة في الإنتاج

Anthropic حاطّة نظام تقييم مزدوج:

آلي عبر LLM زي internal judge بيقيّم الدقة، الجودة، والشمولية.

بشريين بيراجعوا النتايج ويضبطوا السياسات، خاصة لو فيه تحيز مثل الاعتماد على مصادر SEO مش موثوقة.

وكمان نظموا الإنتاج بتقنيات زي checkpoint/resume عند الأخطاء و”rainbow deployments” للتحديث التدريجي بدون تعطيل الجلسات الجارية ([turn0search1]).

لمحة مستقبلية

Anthropic شايفين إنه لما تنتقل لمعمارية asynchronous (الوكلاء يشتغلوا بمواعيد مختلفة ومن غير انتظار) هتوصل لكفاءة أعلى ومرونة أكبر في المستقبل.

الخلاصة

Anthropic طوّروا Claude Research بنظام multi-agent فعّال وقابل للتوسع.

استخدموا هندسة ذكية في الـ prompts، تقسيم المهام، واختيار الأدوات، علشان يحسّنوا الأداء والدقة.

ده بيجيب cons مثل استخدام موارد أعلى، لكن الشغل عالي القيمة فعلاً بيستاهل التكلفة.

ده مش مجرد نظرية، ده نظام شغال فعلاً في الإنتاج.

المقال كامل هنا:

https://www.anthropic.com/engineering/multi-agent-research-system